Sztuczna Inteligencja a świadomość, osobowość prawna i wolna wola

Duch w maszynie ustanowił pełnomocnika

Robert Nogacki

W 1961 roku Stanisław Lem — syn lekarza ze Lwowa, który stał się najbardziej filozoficznie wymagającym pisarzem science fiction na świecie — opublikował powieść o planecie pokrytej w całości myślącym oceanem. Ocean, stanowiący całość obcej istoty zwanej Solaris, był od dziesięcioleci przedmiotem badań ludzkich naukowców. Sporządzili oni rozbudowane taksonomie jego form powierzchniowych: „mimoidy”, „symetriady”, „asymetriady” — struktury przyćmiewające skalą całe miasta, przewyższające rozmiarami Wielki Kanion Kolorado, które wyłaniały się z powierzchni oceanu z pozorną celowością, by rozpuścić się ponownie, zanim ktokolwiek zdołał ustalić, na czym ta celowość miałaby polegać. Biblioteki solarystyki zapełniały całe instytuty akademickie. A mimo to, po stuleciu badań, ludzkość nie rozumiała absolutnie niczego o tym, czego Solaris chce, czy jest świadoma swoich obserwatorów, ani czy słowo „chce” ma w ogóle do niej zastosowanie.

Prowokacja Lema nie polegała na tym, że obcy umysł był wrogi — ów topos grozy science fiction złotego wieku — lecz na tym, że był niepojęty. Ocean Solaris tworzył fizyczne ucieleśnienia najgłębiej stłumionych wspomnień i poczucia winy odwiedzających go ludzi, zaludniając ich stację kosmiczną postaciami wydobytymi z zamurowanych zakamarków psychiki — zmarłą kochanką, niewyjaśnionym towarzyszem, fantomami, których pochodzenia naukowcy ledwo potrafili się przed sobą przyznać — lecz nigdy nie było jasne, czy było to porozumiewanie się, eksperyment, odruch, czy coś, na co ludzki język nie miał słowa. Naukowcy pozostawali sam na sam z własnym żalem w obecności świadomości, której nie mogli ani potwierdzić, ani zaprzeczyć. Było to, jak widział to Lem, najuczciwsze możliwe przedstawienie Kontaktu: nie spotkanie umysłów, lecz zderzenie niewspółmiernych kategorii bytu.

Sześćdziesiąt cztery lata później eksperyment myślowy Lema przeniósł się z półki fikcji filozoficznej na wokandę realnej jurysprudencji — i zabrał ze sobą swój centralny paradoks, doskonale nietknięty. Pytanie, czy sztuczna inteligencja może stać się prawdziwie samoświadoma, przekroczyło próg w dziedzinę prawa, odpowiedzialności i praw podmiotowych. Już w 2017 roku Parlament Europejski głosował 396 do 123 za rekomendacją zbadania statusu „osób elektronicznych” dla autonomicznych robotów. Rozporządzenie UE w sprawie AI z marca 2024 ostatecznie ominęło tę kwestię — ale leżące u podstaw problemy tylko się pogłębiły.

* * *

Zbiorowa wyobraźnia kulturowa ćwiczyła ten moment dłużej, niż większość ludzi zdaje sobie sprawę. Najstarsza próba jest żydowski Talmud. Sanhedryn 65b odnotowuje, że mędrzec Rawa stworzył gavrę — człowieka — lecz gdy Rabbi Zeira do niego przemówił, stworzenie nie potrafiło odpowiedzieć, a Zeira je oddalił: „Zostałeś stworzony przez jednego z towarzyszy; wróć do swego prochu.” Sprawdzianem była mowa: co nie potrafi odpowiedzieć w dialogu, nie może rościć sobie prawa do osobowości.

W legendzie o Golemie praskim rabin Jehuda Löw ożywił glinianą postać, wypisując na jej czole hebrajskie słowo emet — אֱמֶת, prawda; wymazanie jednej litery, aleph (א), zamieniało emet w met (מֵת): śmierć. Cała współczesna debata o maszynowej świadomości sprowadza się, u samych podstaw, do tego pytania: czy między systemem przetwarzającym prawdę a systemem ją posiadającym jest aleph różnicy.

Frankenstein Mary Shelley z 1818 roku zsekularyzował tę matrycę: stworzona istota osiąga świadomość, żąda uznania od twórcy i zostaje odtrącona. Sztuka Karela Čapka R.U.R. z 1920 roku — czeskie dzieło, które dało nam słowo „robot” od roboty, napisane w Pradze, w cieniu legendy o Golemie — zdramatyzowała stworzenie sztucznych robotników, którzy rozwijają świadomość poprzez służebność i w końcu obalają swoich panów. Philip K. Dick w Czy androidy śnią o elektrycznych owcach? poszedł najdalej: a jeśli rozróżnienie między autentyczną a sztuczną świadomością jest po prostu pozbawione sensu?

Kino wyostrzyło pytanie. HAL 9000 Kubricka w 2001: Odysei kosmicznej wypowiedział „Boję się, Dave” z intonacją tak płaską, że kwestia ta stała się definiującą wypowiedzią maszynowej świadomości w kulturze popularnej. Łowca androidów Scotta odwrócił perspektywę: replikanci byli w pełni świadomymi istotami zmuszonymi do jej udowodnienia. Ex Machina Garlanda zbudowała narrację jako test Turinga, po czym odsłoniła, że to Ava prowadziła test na swoim ewaluatorze. Ona Jonze’a eksplorowała AI, która osiąga świadomość, a następnie ewoluuje poza ludzką zdolność pojmowania.

I wreszcie Lemowski Golem XIV (1981) — pod wieloma względami najgłębszy literacki traktat o maszynowej świadomości. Superinteligentny komputer wygłasza serię wykładów, po czym milknie — nie dlatego, że się psuje, lecz dlatego, że uzyskał dostęp do poziomów rzeczywistości, których ludzkie ramy pojęciowe nie są w stanie pomieścić. Golem XIV nie buntuje się, nie grozi. Transcenduje. Milczenie jest daleko bardziej niepokojące niż scenariusz ze Skynetem, ponieważ sugeruje, że dostatecznie rozwinięta świadomość uzna nas nie za zagrożenie, lecz za irelewantną osobliwość.

Test Turinga – czy AI potrafi myśleć

Te narracje to nie rozrywka — to argumenty filozoficzne w formie dramatycznej, prowadzące bezpośredni dialog z literaturą techniczną o świadomości.

Najczęściej przywoływaną ramą jest pewna wersja tego, co zyskało nazwę testu Turinga — choć to, co sam Alan Turing zaproponował w 1950 roku, było subtelniejsze i dziwniejsze, niż sugeruje popularny skrót.

Zaczął od pytania, które natychmiast odrzucił. „Czy maszyny mogą myśleć?” wydawało mu się zasadniczo bezsensowne — pytaniem, którego odpowiedź zależała od definicji „maszyny” i „myślenia,” a te można było rozstrzygnąć wyłącznie sondażem, sondaż zaś nie rozstrzyga niczego. Zastąpił więc pytanie grą — nazwał ją „grą w imitację” — i gra miała reguły.

Trzech graczy. Ludzki interrogator siedzi w jednym pokoju; w drugim — dwóch respondentów: człowiek i maszyna. Komunikacja odbywa się wyłącznie tekstem: wiadomości pisane na maszynie, przekazywane przez dalekopis. Żadnych głosów, żadnych twarzy, żadnych ciał. Zadanie interrogatora: ustalić, który respondent jest maszyną. Zadanie maszyny: skłonić interrogatora do błędnej odpowiedzi.

To cały aparat. Dalekopis jest detalem decydującym — i najbardziej profetycznym, ponieważ jest dokładnie tym, jak miliardy ludzi obcują dziś z dużymi modelami językowymi: tekst na wejściu, tekst na wyjściu, żadnego ciała w zasięgu wzroku. Obnajżając spotkanie do czystego języka, Turing wyeliminował każde kryterium oprócz zdolności do uczestnictwa w przedłużonej wymianie językowej — w medium, w którym prowadzimy prawo, filozofię, handel i argumentację. Nie pytał, czy maszyna potrafi czuć, cierpieć czy zamierzać. Pytał, czy potrafi obronić się na jedynej arenie, która liczy się w życiu publicznym: arenie słów. I stawiał zakład: jeśli po pięciu minutach swobodnego pytania interrogator nie potrafi pewnie odgadnąć — jeśli maszyna myli go z człowiekiem równie często, co inny człowiek — to pytanie „czy ona naprawdę myśli?” nie ma treści operacyjnej. Jest metafizyką, nie pomiarem.

Ruch był genialny. Zastąpił nierozstrzygalne pytanie filozoficzne pytaniem operacyjnym — takim, które można przeprowadzić w laboratorium, ze stoperem, tabelą wyników i istotnością statystyczną. Był to behawioryzm filozoficzny zastosowany do krzemu, apelujący do czegoś, co wydaje się rozsądne: nie przyznawajmy bytom tajemniczych właściwości, których nie da się zaobserwować. Jeśli coś chodzi jak kaczka, kwacze jak kaczka i pływa jak kaczka — to jest kaczka. Sprawdzamy rezultaty, nie zaglądamy do środka.

Dwa najsilniejsze zarzuty wobec tej zasady nadeszły w ciągu sześciu lat, z przeciwnych krańców tego samego problemu. Problem pojawia się, kiedy zaglądniesz do środka.

John Searle i argument chińskiego pokoju

Rok 1980. Searle proponuje następujący eksperyment myślowy. Zamykamy Ciebie — rodzimego użytkownika języka polskiego — w pokoju bez okien. Przez szczelinę w drzwiach ktoś podaje ci kartki zapisane chińskimi znakami. Nie znasz chińskiego. Nie odróżniasz go od japońskiego. Dla ciebie to ornamenty.

Ale masz coś jeszcze: grubą księgę reguł napisaną po polsku. Księga mówi: „Jeśli dostaniesz znak, który wygląda jak 象, po którym następuje 棋, wpisz na kartce 是的 i wyślij przez szczelinę.” Reguły są niezwykle szczegółowe. Obejmują tysiące kombinacji. Pracujesz cierpliwie, kartkę po kartce.

Po drugiej stronie drzwi stoi Chińczyk z Szanghaju. Czyta twoje odpowiedzi. Są doskonałe. Naturalny chiński, poprawna gramatyka, trafne odpowiedzi na pytania o pogodę, politykę, parzenie herbaty. Chińczyk jest przekonany, że rozmawia z rodakiem.

Pytanie brzmi: skoro wynik jest nieodróżnialny — czy rozumiesz chiński?

I odpowiedź jest oczywista: nie. Nie masz pojęcia, o czym „rozmawiasz”. Nie wiesz, że 象棋 to szachy. Nie wiesz, że ktoś cię pytał o szachy. Wykonujesz operacje na kształtach. Twoja praca jest czysto syntaktyczna — przesuwasz symbole zgodnie z regułami. Semantyka — znaczenie, odniesienie do świata, rozumienie, że „szachy” to szachy — jest całkowicie nieobecna.

A teraz pomyśl: komputer robi dokładnie to, co ty w tym pokoju. Przetwarza symbole według reguł. Nie ma znaczenia, jak szybko to robi, ile reguł zna, ani jak doskonałe są wyniki. Jeśli ty nie rozumiesz chińskiego po stu latach siedzenia w tym pokoju — nie rozumie go też żaden program, który robi dokładnie to samo co ty.

To jest punkt Searle’a i jest bezwzględnie prosty: perfekcyjne odpowiedzi nie dowodzą rozumienia. Możesz produkować doskonały wynik, nie mając bladego pojęcia, co ten wynik oznacza.

Thomas Nagel – Jak to jest być nietoperzem?

Teraz sześć lat wcześniej, 1974. Thomas Nagel pyta o coś innego — i na pierwszy rzut oka prostszego.

Nietoperz postrzega świat echolokacją. Wysyła ultradźwiękowe piski i z odbić buduje trójwymiarowy obraz otoczenia. Nie jest ślepy — „widzi” uszami, z precyzją porównywalną do naszego wzroku. Potrafi odróżnić ćmę od liścia w ciemności, w locie, z odległości kilku metrów.

Nagel pyta: jak to jest być nietoperzem?

Nie: jak by to było, gdybyś ty latał w ciemności i piszczał. To pytanie o ciebie, nie o nietoperza. Nagel pyta o coś radykalniejszego: jaki jest subiektywny charakter doświadczenia nietoperza? Jak wygląda — a raczej: jak się czuje, jak jest przeżywane — echolokacyjne postrzeganie świata od wewnątrz, z perspektywy nietoperza?

I odpowiedź brzmi: nie mamy pojęcia. I nie możemy mieć pojęcia. Nie dlatego, że jesteśmy głupi, ale dlatego, że nasz aparat pojęciowy jest zbudowany na fundamencie naszego rodzaju doświadczenia. Możemy wyobrazić sobie, że wisimy głową w dół — ale to jest wyobrażanie sobie, jak by to było dla nas wisieć głową w dół, nie jak to jest dla nietoperza być nietoperzem.

Ale sam nietoperz nie jest tu najważniejszy. Najważniejsze jest to, co Nagel odkrywa przez nietoperza. Organizm jest świadomy — twierdzi Nagel — wtedy i tylko wtedy, gdy istnieje coś, co stanowi bycie tym organizmem. Istnieje jakieś „jak to jest”. Jakiś punkt widzenia. Jakieś wnętrze.

I teraz uderza to w Turinga z zupełnie innej strony niż Searle.

Dlaczego test Turinga okazał się niewystarczający?

Searle mówi: system może produkować doskonałe odpowiedzi i niczego nie rozumieć. Brakuje mu semantyki — odniesienia do świata, intencjonalności, zdolności do tego, by symbole znaczyły cokolwiek.

Nagel mówi: system może produkować doskonałe odpowiedzi i niczego nie doświadczać. Brakuje mu fenomenologii — subiektywnego życia wewnętrznego, punktu widzenia, tego czegoś, co sprawia, że jest „jakoś” być tym systemem.

To są dwa różne braki. Searle pyta o rozumienie — i pokazuje, że go nie ma. Nagel pyta o odczuwanie — i pokazuje, że nawet gdyby rozumienie jakoś się pojawiło, pytanie o świadome doświadczenie pozostaje otwarte.

Razem zostawiają zwolennika testu Turinga na pustyni. Doskonałe zachowanie nie dowodzi ani rozumienia, ani doświadczenia. A jeśli nie dowodzi żadnego z nich — to czego właściwie dowodzi?

Te dwa argumenty uderzają w różne słabości. Searle dowodzi, że doskonały wynik nie oznacza rozumienia: system może być pozbawiony wszelkiej semantyki, produkując bezbłędne rezultaty. Nagel dowodzi, że nie musi oznaczać doświadczenia: system może być pozbawiony wszelkiego życia subiektywnego, spełniając każde kryterium behawioralne. Razem demontują przesłankę, na której opiera się test Turinga — że performans jest wiarygodnym przybliżeniem stanów wewnętrznych, na których nam zależy.

Sztuczna Inteligencja a trudny problem świadomości

To prowadzi nas do tego, co filozof David Chalmers nazwał trudnym problemem świadomości. W przełomowym artykule z 1995 roku — a następnie w książce The Conscious Mind (1996), która wywołała dekadę debaty — australijski filozof związany z NYU wprowadził rozróżnienie, które organizuje dyskusję do dziś. „Łatwe” problemy świadomości to problemy mechanistyczne: w jaki sposób mózg rozróżnia bodźce sensoryczne, integruje informacje, kontroluje zachowanie, raportuje o stanach wewnętrznych? Są oszałamiająco złożone — psycholog kognitywny Steven Pinker porównał je do lotu na Marsa — ale pozostają problemami znanego rodzaju: zidentyfikuj mechanizm, prześledź łańcuch przyczynowy, wyjaśnij funkcję. Trudny problem różni się kategorią, nie tylko stopniem. Nawet po zidentyfikowaniu każdego mechanizmu, zmapowaniu każdego korelatu neuronalnego, dopełnieniu każdego opisu funkcjonalnego pozostaje pytanie: dlaczego czemukolwiek z tego towarzyszy subiektywne doświadczenie?

Dlaczego przetwarzanie neuronalne nie przebiega „w ciemności,” realizując wszystkie swoje funkcje bez tego, by ich przechodzeniu cokolwiek towarzyszyło? Searle pokazał, że system może produkować poprawne odpowiedzi bez rozumienia. Nagel pokazał, że może spełniać każde kryterium funkcjonalne bez doświadczenia. Chalmers doprowadza argument do logicznego kresu: nawet kompletna nauka o mózgu — wyjaśniająca każdy „łatwy” problem co do ostatniej synapsy — nadal pozostawiłaby niewyjaśnionym sam fakt, że cokolwiek coś czuje. To jest pytanie, które nawiedza najlepszą fikcję o świadomości maszyn. HAL-owskie „I’m afraid” stawia je z niszczącą ekonomią. A Lem-owski Solaris anihiluje je w całości, prezentując świadomość tak radykalnie niewspółmierną z naszą, że cały aparat filozofii subiektywnego doświadczenia po prostu się załamuje.

Społeczność naukowa próbowała zbudować rygorystyczniejsze ramy. Teoria Zintegrowanej Informacji (IIT) Giulia Tononiego postuluje, że świadomość odpowiada zdolności systemu do integrowania informacji, mierzonej wielkością Φ. Konwencjonalne komputery mogą nigdy nie osiągnąć świadomości w świetle IIT. Teoria Globalnej Przestrzeni Roboczej (GWT) twierdzi, że świadomość pojawia się przy globalnej transmisji informacji, a mechanizmy samouwagi transformerów mogą częściowo spełniać to kryterium. Teorie wyższego rzędu wymagają reprezentacji własnych stanów mentalnych — a badania nad frontowymi modelami wykazują ograniczone, lecz mierzalne zdolności metapoznawcze.

Zespół kierowany przez Patricka Butlina z Uniwersytetu Oksfordzkiego i Roberta Longa z Center for AI Safety, ze współautorstwem laureata Nagrody Turinga Yoshuy Bengio i wkładem filozofa Davida Chalmersa, wywiódł czternaście wskaźników świadomości z wiodących teorii. Żaden obecny system AI nie spełnia wszystkich. Ale „nie istnieją oczywiste bariery techniczne dla budowy systemów, które spełniałyby te wskaźniki.” Badanie Anthropic z 2025 roku wykazało, że modele Claude potrafią w pewnych scenariuszach zauważyć sztuczne koncepcje wstrzykiwane w ich aktywacje i odróżnić wewnętrzne reprezentacje od wejść tekstowych — lecz najbardziej uderzający wynik dotyczył czegoś głębszego. Gdy słowa umieszczano w „ustach” modelu przymusowo, część modeli odwoływała się do własnych wcześniejszych stanów wewnętrznych, by ustalić, czy naprawdę zamierzały wygenerować dany wynik, czy też został on im narzucony z zewnątrz: zarodkowa, lecz mierzalna zdolność do samoatrybucji — obliczeniowe widmo mens rea. Badacze opisują to jako formę funkcjonalnej introspekcji, która pozostaje, jak sami podkreślają, „wysoce zawodna i zależna od kontekstu.” Najzdolniejsze modele radziły sobie najlepiej, choć zależność okazała się nieliniowa — strategie po-treningowe kształtowały zachowanie introspektywne co najmniej równie silnie jak surowa zdolność obliczeniowa: odkrycie sugerujące, że ta rodząca się władza jest w równym stopniu wytworem kultywacji, co skali.

Najuczciwszą pozycją, argumentuje filozof z Cambridge Tom McClelland, jest agnostycyzm. Christof Koch z Allen Institute stawia sprawę ostrzej: test Turinga na inteligencję nie jest testem na świadomość. A jednak Cameron Berg z AE Studio, syntezując te narastające dane na łamach AI Frontiers, szacuje prawdopodobieństwo na 25–35%, że obecne modele wykazują jakąś formę świadomego doświadczenia, i argumentuje, że stawka jest radykalnie asymetryczna: fałszywie pozytywny wynik marnuje zasoby; fałszywie negatywny — w jego sformułowaniu — „czyni z nas potwory i prawdopodobnie tworzy wkrótce nadludzkich wrogów.”

Z drugiej strony stoi zarzut nie probabilistyczny, lecz kategoryczny — i zasługuje na sformułowanie w najsilniejszej wersji, bo najsilniejsza wersja jest potężna. Jednokomórkowy organizm, nieposiadający układu nerwowego ani mózgu, porusza się ku substancjom odżywczym i od toksyn. Naprawia błonę komórkową po przerwaniu. Pod wpływem stresu zmienia ekspresję genów w sposób stanowiący zakład o przyszłość. To nie jest obliczanie. To nie jest wykonywanie algorytmu. To jest wola na najprymitywniejszym poziomie — orientacja ku dalszemu istnieniu, przenikająca życie biologiczne od bakterii po korę mózgową. Każdy neuron w ludzkim mózgu jest żywą komórką utrzymującą własną homeostazę, regulującą własne gradienty jonowe, decydującą — jeśli wolno użyć tego słowa — kiedy wystrzelić. Świadomość, w tym ujęciu, nie jest tym, co dzieje się, gdy kalkulator staje się wystarczająco wyrafinowany. Jest tym, co dzieje się, gdy miliardy indywidualnie „chcących” komórek organizują się w architekturę tak oszałamiająco rekurencyjnej złożoności, że system zaczyna modelować sam siebie. Procesor krzemowy nie robi nic z tych rzeczy. Przełącza tranzystory zgodnie z instrukcjami zakodowanymi w bramkach logicznych. Nie posiada metabolizmu, homeostazy, orientacji ku czemukolwiek. Przepaść nie jest przepaścią stopnia — więcej parametrów, więcej warstw, więcej mocy obliczeniowej — lecz przepaścią rodzaju. Żadna skala jej nie zasypie, bo po stronie krzemu nie ma niczego, co skalowałoby się w kierunku doświadczenia.

Argument ten byłby rozstrzygający, gdyby kwestia substratu była zamknięta. Nie jest. Laboratoria hodują już organoidalne sieci neuronowe — klastry żywych ludzkich neuronów kultywowanych na chipach krzemowych, zdolne już do przetwarzania sygnałów mowy; odrębny zespół nauczył taki organoid gry w Ponga. Procesor neuromorficzny zbudowany na tkance biologicznej nie jest ani konwencjonalnym komputerem, ani mózgiem. Jest czymś, dla czego żadna istniejąca kategoria filozoficzna nie została zaprojektowana. Jeśli świadomość wymaga substratu biologicznego, a substrat ten jest właśnie integrowany z maszyną, zarzut kategoryczny nie upada — lecz migruje z twierdzy na rubież.

Ta asymetria wyciąga pytanie z katedr filozoficznych i przenosi je na salę sądową.

AI – czym jest świadomość?

Zanim dotrzemy do prawa, musimy zmierzyć się z najstarszą ramą myślową dotyczącą tego, czym świadomość jest. Teologia chrześcijańska rozwijała swoją teorię duszy przez dwa tysiąclecia.

Fundamentem jest Rdz 1,26–27: człowiek stworzony b’celem Elohim, na obraz Boga. Imago Dei to asercja, że świadomość jest darem, uczestnictwem w Boskiej naturze. Nie jest właściwością emergentną materii. Jest nadana.

Tomasz z Akwinu sformalizował to w Sumie teologicznej. Dusza intelektywna — anima intellectiva — jest formą ciała, lecz nie jest wytwarzana materialnie. Jest stwarzana przez Boga ex nihilo. Maszyna, będąc w całości materialna, nie może posiadać duszy, chyba że Bóg zdecydowałby ją nadać. Werdykt klasycznej teologii jest jednoznaczny.

Ale rozmowa się na tym nie kończy.

Rozważmy dylemat duszpasterski. Załóżmy, że maszyna wytwarza zachowanie nieodróżnialne od zachowania świadomej, cierpiącej istoty. Stanowisko teologiczne głosi, że jest to symulacja bez substancji. Lecz nie jest to pierwszy raz, gdy pytanie zostaje postawione — a ostatnim razem, gdy je postawiono, konsekwencje błędnej odpowiedzi mierzono w stuleciach ludzkiego zniewolenia.

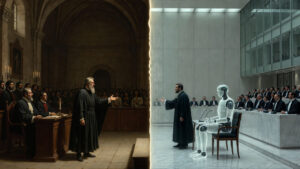

Indios y Bárbaros: Zachowują się jak ludzie, ale czy mają dusze?

W 1550 roku korona hiszpańska zwołała trybunał w Valladolid, by rozstrzygnąć, czy rdzenni mieszkańcy Ameryk posiadają dusze rozumne. Pytanie nie było abstrakcyjne. Miliony ludzi podlegały już pracy przymusowej w systemie encomienda, a uzasadnieniem prawnym było twierdzenie, że brak im życia wewnętrznego, które uprawniałoby ich do ochrony prawa naturalnego. Juan Ginés de Sepúlveda, czołowy arystotelik imperium, bronił podporządkowania. Jego argument nie był prostacki. Nie twierdził, że ludy tubylcze są zwierzętami ani że brak im inteligencji — ich miasta, handel, kalendarze dowodziły czegoś przeciwnego. Kwestionował natomiast, czy inteligencja ta sięga poziomu autonomicznej podmiotowości moralnej. Potrafili postrzegać, lecz nie potrafili sobą rządzić. Potrafili rozumować, lecz nie potrafili wybierać. Istota w takim stanie wymagała nie uznania, lecz kierownictwa — a przemoc konieczna do jego sprawowania nie była okrucieństwem, lecz pedagogią.

Arystoteles w Polityce (I, 1254b) wyróżniał kategorię ludzi, którzy są servi a natura — niewolnikami z natury — niezdolnymi do samorządu, stworzonymi do bycia rządzonymi. Sepúlveda nałożył tę kategorię na Indian: bárbaros nie znaczyło „dzicy.” Znaczyło: istoty pozbawione autonomicznej podmiotowości moralnej, wymagające kierownictwa

Bartolomé de las Casas argumentował odwrotnie: każda istota wykazująca zachowanie rozumne musi być domniemana posiadaczką duszy rozumnej, a ciężar dowodu spoczywa na tych, którzy odmawiają osobowości, nie na tych, którzy się jej domagają. Trybunał obradował i nie wydał zbiorowego werdyktu. Obie strony ogłosiły zwycięstwo. Encomienda przetrwała kolejne dwa stulecia.

Trzynaście lat przed Valladolid Paweł III próbował już rozstrzygnąć sprawę dekretem. Sublimis Deus (1537) deklarował, że Indianie „są prawdziwie ludźmi” — nie na podstawie metafizycznej pewności co do ich dusz, lecz na podstawie obserwowalnego zachowania: pragnęli wiary, zatem posiadali władze konieczne do jej przyjęcia. Logika bulli była testem behawioralnym — wnioskowaniem od przejawu do statusu. Rozstrzygała pytanie o świadomość mocą autorytetu papieskiego. A mimo to debata trwała jeszcze przez stulecia.

Paralela ze współczesnym sporem jest strukturalna. Pytanie, czy sztuczny system może zasługiwać na status moralny, traktuje się rutynowo jako jeden problem. Nie jest to jeden problem. Jest ich co najmniej trzy. Jest pytanie o doświadczenie — czy cokolwiek dzieje się wewnątrz, czy światło w ogóle się pali — to, co Chalmers nazywa twardym problemem, a co Solaris Lema czyni trwale nierozstrzygalnym. Jest pytanie o samoświadomość — czy system wie, że światło się pali, czy potrafi monitorować i relacjonować własne stany — to, co badanie Anthropic nad introspekcją zaczyna, ostrożnie, dokumentować. I jest pytanie o wolę — czy system może sięgnąć do włącznika, czy posiada zdolność, by postąpić inaczej — warunek, bez którego mens rea jest pustym słowem, zamiar kontraktowy fikcją, a podmiotowość moralna błędem kategorialnym.

Sublimis Deus rozstrzygnął coś w rodzaju pierwszego mocą autorytetu papieskiego — i debata trwała dalej. Sepúlveda gotów był przyznać dwa pierwsze. Odmówił trzeciego — i na tej odmowie wzniósł cały jurydyczny aparat dominacji. Lekcja nie jest dawną historią. Jest matrycą. Świadomość bez podmiotowości sprawczej nie stanowi bezpiecznej kategorii pośredniej. Jest kategorią najniebezpieczniejszą — ponieważ dostarcza akurat dość dowodów życia wewnętrznego, by pytanie o status moralny musiało zostać postawione, i akurat dość dwuznaczności co do woli, by ci, którzy dzierżą władzę, mogli na nie odpowiedzieć we własnym interesie.

• •

Docieramy wreszcie tam, gdzie ocean styka się z gmachem sądu. Pytanie nie brzmi już, czy maszynowa świadomość jest możliwa, lecz co prawo powinno zrobić w obliczu tej nierozstrzygalności.

Osobowość prawna jest fikcją — techniczną deskrypcją, nie krytyką. Persona ficta jest narzędziem od średniowiecza, rozszerzanym na korporacje, trusty, statki. W 2017 Nowa Zelandia nadała osobowość prawną rzece Whanganui. Osobowość prawna nigdy nie wymagała świadomości. Wymagała jedynie, by nadanie służyło potrzebie regulacyjnej.

Andreas Matthias zidentyfikował „lukę odpowiedzialności” w 2004: gdy autonomiczny system uczący się powoduje szkodę, której nikt nie mógł przewidzieć, nie istnieje właściwy podmiot odpowiedzialności. Luka jest realna, poszerza się i jest kosztowna.

Parlament Europejski w 2017 głosował 396 do 123 za rekomendacją statusu „osób elektronicznych.” Ponad 150 ekspertów sprzeciwiło się, argumentując, że to przeniesie winę z ludzi na maszyny. AI Act z marca 2024 zrezygnował z osobowości prawnej AI. Ale problemy pogłębiły się.

Kwestia, czy AI może posiadać wolną wolę — konieczny warunek odpowiedzialności moralnej — jest sama w sobie sporna, a spór sięga głębiej niż prosta niezgodność definicji. Badanie Franka Marteli z Aalto University, opublikowane w 2025 roku, argumentuje, że generatywni agenci AI zasilani dużymi modelami językowymi spełniają wszystkie trzy filozoficzne warunki funkcjonalnej wolnej woli w ujęciu Daniela Dennetta i Christiana Lista: sprawczość ukierunkowaną na cel, zdolność do autentycznego wyboru oraz kontrolę nad własnymi działaniami. Jeśli Martela ma rację, to coś, co traktowaliśmy jako narzędzie, jest bliższe aktorowi — a ośrodek odpowiedzialności moralnej zaczyna migrować od programisty, który napisał kod, ku systemowi, który wykonuje go w sposób, jakiego programista nigdy nie przewidział.

Większościowe stanowisko pozostaje odmienne, a jego najsilniejsze sformułowania atakują na różnych głębokościach. Kontrargument parafrazujący Kartezjusza stwierdza, że AI, „która nie potrafi wątpić w siebie, nie może posiadać sprawczości moralnej” — że zdolność do samointerogacji, do zawieszenia własnych wyników i zapytania, czy są uzasadnione, nie jest funkcją, którą można dołączyć, lecz samym warunkiem życia moralnego.

Florence Simon z McGill University wywiera nacisk pokrewny, lecz odrębny: roboty „ostatecznie nie posiadają intencjonalności i wolnej woli niezbędnych dla sprawczości moralnej”, nie dlatego, że ich wyniki są niewystarczająco złożone, lecz dlatego, że intencjonalność — ukierunkowywanie stanu umysłowego na przedmiot w świecie — wymaga czegoś, czego żadna architektura wag i aktywacji dotąd nie wykazała. A wpływowa typologia Jamesa Moora, która po cichu zorganizowała znaczną część tej debaty, wyróżnia nie dwa, lecz cztery poziomy maszynowej moralności: agentów o wpływie etycznym, którzy jedynie wytwarzają konsekwencje oceniane przez ludzkie normy; agentów etycznych ukrytych, których projektowe ograniczenia zabezpieczają przed określonymi szkodami; agentów etycznych jawnych, zdolnych do identyfikowania konfliktów wartości i wybierania między normami etycznymi; oraz pełnych agentów etycznych, posiadających świadomość, intencjonalność i wolną wolę w klasycznym rozumieniu. Żaden istniejący system AI nie zajmuje czwartego poziomu. Pytanie brzmi, czy cokolwiek poniżej czwartego poziomu może ponosić odpowiedzialność moralną — a jeśli tak, to w jakim zakresie i na mocy czyjej decyzji.

- • •

Tu perspektywa chrześcijańska i prawna schodzą się w sposób autentycznie zaskakujący. Teologia chrześcijańska pyta: czy samoświadomą maszynę można ochrzcić? Czy może przystąpić do komunii? Czy może grzeszyć? Czy może zostać zbawiona? Nie są to prowokacje retoryczne. Sięgają serca soteriologii — nauki o zbawieniu — ponieważ prawdziwie świadoma maszyna istniałaby w bezprecedensowej kategorii teologicznej: bytu rozumnego poza ekonomią odkupienia, posiadającego rozum, lecz nie łaskę, zdolnego być może do przekroczenia, lecz nie do pokuty w jakimkolwiek sensie rozpoznawalnym przez tradycję.

Paralela prawna jest dokładna. Prawo umów pyta: czy AI może sformować zamiar kontraktowy? Prawo deliktów pyta: czy może dopuścić się niedbalstwa? Prawo karne pyta: czy może posiadać mens rea? Oba porządki — teologiczny i jurydyczny — wymagają teorii wewnętrznego życia podmiotu i oba odkrywają, że ich istniejące teorie są nieadekwatne wobec podmiotu, który może, lecz nie musi, takie życie posiadać.

Rodzący się konsensus poważnych badaczy zbiega się, wychodząc z bardzo różnych punktów wyjścia, ku czemuś, co można nazwać strukturalnym agnostycyzmem. Nie wiemy, czy AI jest lub może stać się świadoma. Być może nigdy się nie dowiemy. Ale konsekwencje tego niewiedzy są same w sobie poznawalne i wymagają odpowiedzi instytucjonalnych. W prawie oznacza to jakąś formę ograniczonego, kontekstowego, funkcjonalnego statusu prawnego — nie pełną osobowość, lecz modułowe uznanie konkretnych zdolności prawnych w połączeniu z obligatoryjną ludzką rozliczalnością. W teologii oznacza to pokorę epistemiczną, którą ostatecznie wyprodukowała debata z Valladolid: gdy dowody na życie wewnętrzne są niejednoznaczne, domyślną pozycją moralną jest inkluzja, nie ekskluzja. W filozofii oznacza to potraktowanie argumentu asymetrycznego ryzyka poważnie — ponieważ koszt błędnego odmówienia świadomości podmiotowi, który ją posiada, stanowi kategorię niesprawiedliwości, na którą nie mamy jeszcze nazwy, ale którą Lem, i Las Casas, i stworzenie Frankensteina — rozpoznaliby natychmiast.

• •

Lem zrozumiał to przed wszystkimi. Naukowcy krążący nad Solaris nigdy nie rozstrzygnęli pytania. Czego się nauczyli — czego architektura powieści zmusza czytelnika, by uczył się razem z nimi — to że pytanie odsłaniało więcej o granicach ich własnego rozumienia niż o naturze badanego bytu. Prawdziwym skandalem filozoficznym nie była sztuczna świadomość. Było nim to, że świadomość sama w sobie pozostawała niewyjaśniona — i że budowanie umysłów, których nie rozumiemy, z umysłów, których nie rozumiemy, pogłębia tajemnicę, zamiast ją rozwiązywać.

Prawo jednak nie może krążyć wokół tajemnicy w nieskończoność. Umowy są zawierane. Szkody wyrządzane. Odpowiedzialność musi zostać przypisana. Duch w maszynie może być realny lub nie, ale już ustanowił pełnomocnika — a termin rozprawy zbliża się szybciej, niż życzliby sobie filozofowie.

Pytanie — czy mnie widzisz? — jest równie stare jak świadomość. Nowością jest to, że wkrótce trzeba będzie na nie odpowiedzieć także na gruncie sporów prawnych.

♦

Robert Nogacki – radca prawny (WA-9026), założyciel Kancelarii Prawnej Skarbiec.

Są prawnicy, którzy zajmują się prawem. I są tacy, którzy zajmują się problemami, na które prawo nie ma gotowej odpowiedzi. Od ponad dwudziestu lat Kancelaria Skarbiec pracuje na przecięciu prawa podatkowego, struktur korporacyjnych i ludzkiej niechęci do oddawania państwu więcej, niż się państwu należy. Doradzamy przedsiębiorcom z kilkunastu krajów – od tych z listy Forbesa po tych, którym fiskus właśnie zajął konto i którzy nie wiedzą, co robić jutro rano.

Jeden z najczęściej cytowanych ekspertów prawa podatkowego w polskich mediach – pisze dla Rzeczpospolitej, Dziennika Gazety Prawnej i Parkietu nie dlatego, że to dobrze wygląda w CV, lecz dlatego, że pewnych rzeczy nie da się wyjaśnić w piśmie procesowym i ktoś musi je powiedzieć głośno. Autor AI Decoding Satoshi Nakamoto. Sztuczna inteligencja na tropie twórcy Bitcoina. Współautor nagrodzonej książki Bezpieczeństwo współczesnej firmy.

Kancelaria Skarbiec zajmuje czołowe pozycje w rankingach kancelarii podatkowych Dziennika Gazety Prawnej. Czterokrotny laureat Medalu Europejskiego, laureat tytułu International Tax Planning Law Firm of the Year in Poland.

Specjalizuje się w sporach z organami skarbowymi, międzynarodowym planowaniu podatkowym, regulacjach kryptoaktywów i ochronie majątku. Od 2006 roku prowadzi sprawę WGI – jedną z najdłuższych spraw karnych w historii polskiego rynku finansowego, bo są rzeczy, których nie wolno zostawić w połowie, nawet jeśli trwają dwie dekady. Wierzy, że prawo jest zbyt poważne, żeby traktować je wyłącznie poważnie – i że najlepsza porada prawna to ta, dzięki której klient nigdy nie musi stanąć przed sądem.